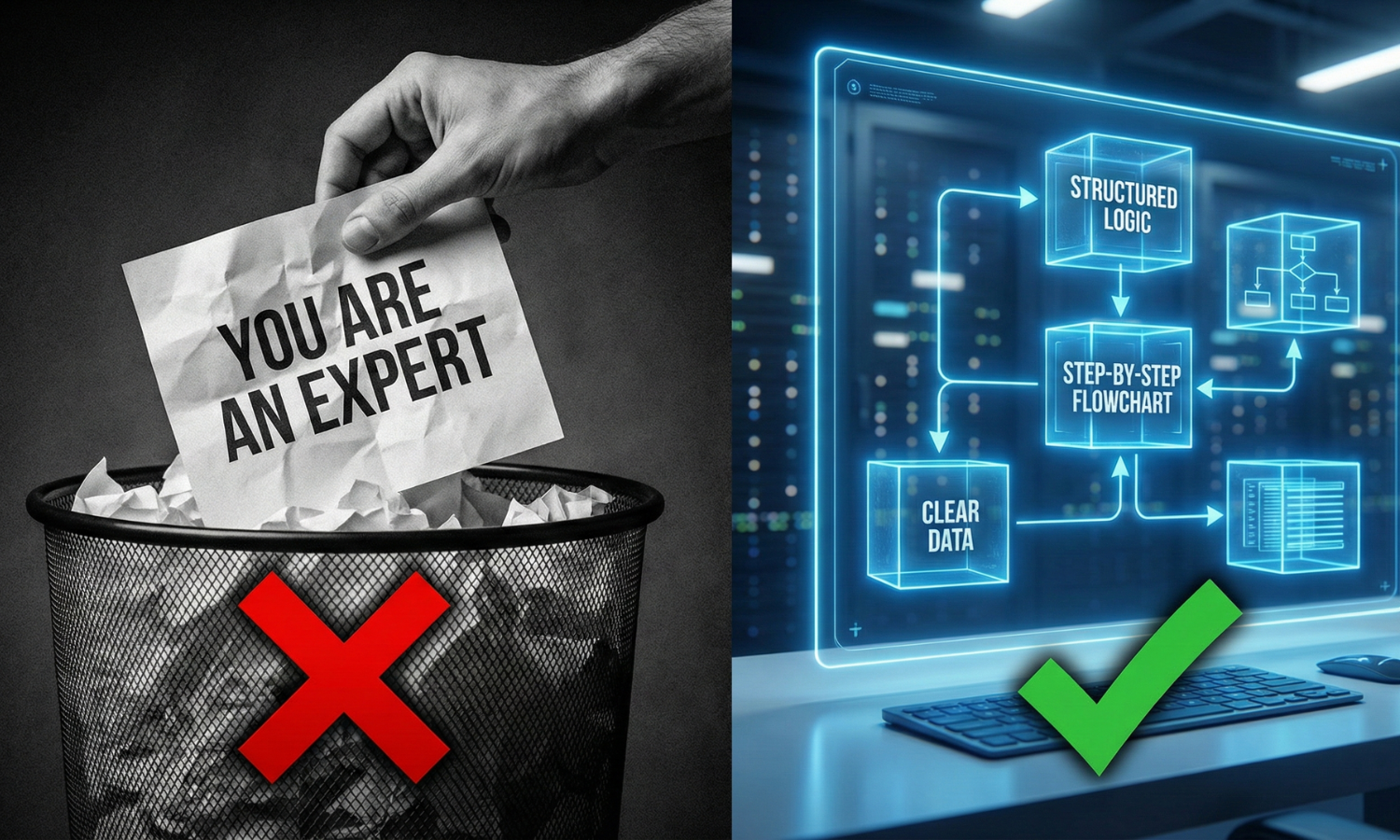

「あなたはプロの〇〇です」という書き出しでAIに指示を出していませんか。プロンプトエンジニアリングの専門家サンダー・シュルホフ氏らによる2025年の研究で、この手法が効果を持たないことが明らかになりました。AIが賢くなった今、小手先のテクニックではなく、本質的な指示方法が求められています。本記事では、時代遅れの手法と、今も有効な実践的なプロンプト技術を解説します。

なぜプロンプト術の常識が変わったのか?

AIモデルの飛躍的な進化

ChatGPT登場当初、AIは曖昧な指示に対応できませんでした。ユーザーは細かい工夫を凝らして、望む回答を引き出す必要がありました。

しかし、GPT-4oやClaude Sonnet 4といった最新モデルは状況が異なります。多少曖昧な指示でも、驚くほど正確に意図を読み取ります。

この進化により、かつて効果的とされた手法の多くが不要になりました。

プロンプトエンジニアリングの2つの使い方

プロンプトエンジニアリングの専門家であるサンダー・シュルホフ氏は、プロンプトエンジニアリング研究の第一人者として2022年10月に世界初のプロンプトエンジニアリングガイド「Learn Prompting」を公開しました。これはChatGPTのリリース(2022年11月)より前のことです。

シュルホフ氏は2025年6月のLenny’s Podcastで、現在のプロンプトを2つに分類しています。

1つ目は「会話型」です。ChatGPTのようなチャットボットとの対話で使います。期待通りの答えが得られない場合、追加の指示で修正できます。

2つ目は「プロダクト実装型」です。システムに組み込まれて自動実行されるプロンプトを指します。1日に何千回も実行されるため、高い精度と再現性が求められます。

シュルホフ氏は、OpenAI、Microsoft、Google、プリンストン大学、スタンフォード大学などと共同で「The Prompt Report」を作成し、1500件以上の研究を分析しました。その結果、適切なプロンプト設計により、完全な失敗状態から高精度な結果へと劇的に改善できた事例が報告されています。

特に「プロダクト実装型」では、プロンプトエンジニアリングの重要性がむしろ増しています。

以下の図表で、2つのプロンプトの違いを確認しましょう。

| 比較項目 | 会話型 | プロダクト実装型 |

|---|---|---|

| 用途 | ChatGPTなどとの対話 | システムへの組み込み・自動実行 |

| 実行回数 | 必要に応じて | 1日数千回以上 |

| 求められる精度 | 中程度(修正可能) | 高い精度・再現性が必須 |

| 修正の容易さ | 追加指示で即座に修正可能 | 事前のテスト・検証が必要 |

| 典型的な使用例 | チャットボット対話 | APIベースの自動処理 |

もう効果がない古いプロンプト術

「あなたはプロの〇〇です」は意味がない

プロンプトの冒頭に「あなたはプロのコピーライターです」と書く手法をロールプロンプティングと呼びます。AIに役割を与えることで、出力の質が上がるという考え方でした。

しかし最新の研究で、この手法は精度向上に全く役立たないことが判明しました。

ある研究では、役割を与えたプロンプトと与えなかったプロンプトで、回答精度に統計的に意味のある差が見られませんでした。

現代のAIモデルは、役割を与えなくても文脈を理解する能力が高まっています。そのため、精度向上を目的としたロールプロンプティングは不要になりました。

ただし例外もあります。文章のスタイルやトーンを調整する場合、ロールプロンプティングは今も有効です。

「あなたはドラえもんです」と指示すれば、ドラえもん風の語り口で回答が返ってきます。表現スタイルを変えたい場合は、引き続き活用できる手法です。

報酬や脅威を与えても無駄

「良い回答には100ドルのチップを与えます」といった報酬や、「良い回答をしないと罰せられます」といった脅威を与える手法も効果がありません。

古いモデルでは機能した可能性がありますが、新しいモデルでは効果が確認されていません。シュルホフ氏も「効果があるという大規模な研究は見たことがない」と述べています。

このような「一文を加えるだけで質が向上する」という小手先のテクニックは、AIが賢くなるほど効力を失います。

もしあなたが今でもこうしたテクニックを使っているなら、一度削除して試してください。それでも十分に満足のいく答えが返ってくるはずです。

今も効果的な6つのプロンプト手法

具体例を示すFew-Shot法

Few-Shotプロンプティングは、求めているアウトプットの具体的な例をいくつか提示する方法です。

たとえば、特定の顧客に送るメールを自分のいつもの書き方でAIに書いてほしいとします。その場合、過去に自分が書いたメールを2〜3通貼り付けます。

「これを参考にして、以下の要件でメールを作成してください」と指示すれば、AIはあなたの文体やトーンを学習します。よりパーソナライズされたアウトプットを生成してくれます。

実際に医療分野のユースケースで、この手法により精度が大幅に向上した例が報告されています。

Few-Shotは今でも最もおすすめできる方法だとシュルホフ氏は述べています。

タスクを分解するDecomposition

複雑な作業をAIに依頼する際、すぐに最終的なアウトプットを求めてはいけません。まずタスクをより小さな「サブタスク」に分解させます。

たとえば自動車販売店のAIチャットで、顧客が「この車を購入したのですが、小さなへこみがあり返品したいです」と問い合わせたとします。

モデルがこの問いに一度に回答しようとすると、適切に処理できない可能性があります。

そこで「この問題を解決するために実行すべきサブタスクをリストアップしてください」と尋ねます。

モデルは以下のようなサブタスクをリストアップするでしょう。

- この顧客は本当に既存の顧客か

- 持っている車の種類は何か

- いつ車を引き取ったのか

- 保険に加入しているか

- 返品ポリシーのどのルールが適用されるか

これらを一つずつ順番に解決するよう指示します。すべての情報が揃ったら、最終的に返品可否を判断できます。

複雑な状況では人間と同じような「考え方の手順」を真似させると効果的です。

以下の図解で、問題分解の流れを視覚的に理解しましょう。

AI自身に評価させるSelf-Criticism

Self-Criticismは、一度AIが出したアウトプットに対して、AI自身にその内容を評価させる手法です。

具体的な手順は次の通りです。

まず通常通りAIにタスクを依頼し、アウトプットさせます。次に「今のアウトプットをレビューして、改善できる点を挙げてください」と指示します。

AIが自己批判に基づいた改善点をリストアップしたら、最後に「その批判点を踏まえて、最初のアウトプットを修正してください」と指示します。

人間がフィードバックを与えるのと同じように、AI自身に「どこがよくないか」を考えさせます。より完成度の高い答えに近づけることができます。

ただし改善を繰り返すのは2回までにとどめてください。3回以上繰り返しても、改善幅が飽和して効果がなくなります。

関連情報を盛り込むAdditional Information

Additional Informationは、タスクに関連すると思われる情報を可能な限り多くプロンプトに含める手法です。

たとえばAIにメールを書いてもらう場合、自分自身の仕事内容や職歴、メールを送る相手との関係性などを伝えます。

AIにデータを分析してもらいたいときには、そのデータがどの会社のもので、その会社がどんな事業をしているのかを説明します。

「会話型」においては、この手法は最も簡単でかつ効果の高いものの一つです。

アウトプットの質がイマイチだと感じたら、まず「何か追加できる情報はないか」と考えてみてください。

複数の視点を統合するEnsembling

Ensemblingは、一つの問題に対して複数の異なるプロンプトまたはモデルを使用する手法です。その結果を統合します。

たとえば「完全自動運転技術」が社会に広まった場合を考えるとき、「悲観的なアナリスト」と「楽観的なテクノロジーエバンジェリスト」の立場で考えさせます。

それぞれの視点で得た結果を最後にまとめることで、メリットとデメリットがバランスよく整理された内容を得られます。

個人で利用する場合でも、GPT-4oとClaude Sonnet 4の両方に同じ質問をして、回答を比較検討するという形で応用できます。

思考プロセスを可視化するThought Generation

Thought Generationは、AIにアウトプットだけを提示させるのではなく、そのアウトプットに至るまでの「思考プロセス」を書き出させる手法です。

最新の推論モデルは、特に指示をしなくても内部で推論を行うようになっています。そのため「ステップ・バイ・ステップで考えてください」と明確に指示する必要性は以前より低くなりました。

しかしモデルはまれに推論プロセスを省略して、いきなり結論だけを出してしまう場合があります。

推論のステップをはっきりと指示することで、そうしたランダムな動きを防げます。

特に「プロダクト実装型」の場合、AIの思考プロセスを可視化することで、どの段階で間違えたのかを把握できます。問題の修正やAIの精度改善を効率よく進められます。

明日から始める実践ステップ

まずは役割設定を削除してみる

今使っているプロンプトから「あなたはプロの〇〇です」という役割設定を削除してください。それでも十分な回答が返ってくるか確認しましょう。

多くの場合、役割設定なしでも品質は変わりません。むしろプロンプトがシンプルになり、読みやすくなります。

具体例を2〜3個用意する

望む形式やスタイルがある場合、具体例を2〜3個用意してください。Few-Shot法を使えば、AIはあなたの意図を正確に理解します。

過去の成果物や参考資料を添付するだけで、アウトプットの質が大きく向上します。

段階的に考えさせる指示を加える

複雑なタスクの場合、「まず問題を小さなステップに分解してください」と指示しましょう。

AIに段階的な思考を促すことで、より正確で信頼できる結果が得られます。

以下のチェックリストで、実践状況を確認できます。

まとめ

2025年の研究により、かつて効果的とされたプロンプト術の多くが不要になりました。「あなたはプロの〇〇です」というロールプロンプトや、報酬を提示する手法は効果がありません。

一方でFew-Shot、Decomposition、Self-Criticism、Additional Information、Ensembling、Thought Generationという6つの手法は今も有効です。

AIが進化した今こそ、小手先のテクニックではなく本質的な指示方法を身につけることが重要です。明日からあなたのプロンプトを見直し、効果的なAI活用を実現しましょう。

本質的な発信の仕組みを

『ハッシンラボPremium』は、社長の想いを資産に変える仕組みを提供します。

参考資料・相談窓口

研究論文

プロンプトエンジニアリング学習

関連記事